Columna de Daniel Rojas: La comprensión de las “inteligencias” creadas por nuestra “inteligencia”

Por estos días, en 1958, Frank Rosenblatt exhibe una máquina llamada Perceptron. El psicólogo estadounidense destacado en el campo de inteligencia artificial lleva consigo láminas con cuadrados impresos a la izquierda o derecha, las que sostiene al frente de Perceptron y que son leídas por la máquina en cuadrículas. Cada cuadrícula registra un 0 o 1, dependiendo de la luz que reciba de la lámina. Luego, Perceptron aplica un algoritmo para obtener un número final. Si es negativo, dirá “izquierda”, y si es positivo dirá “derecha”. Si la máquina se equivoca, Rosenblatt ajusta las ponderaciones en los circuitos. Varios intentos después, Perceptron logra “distinguir” consistentemente la ubicación de los cuadros en las láminas.

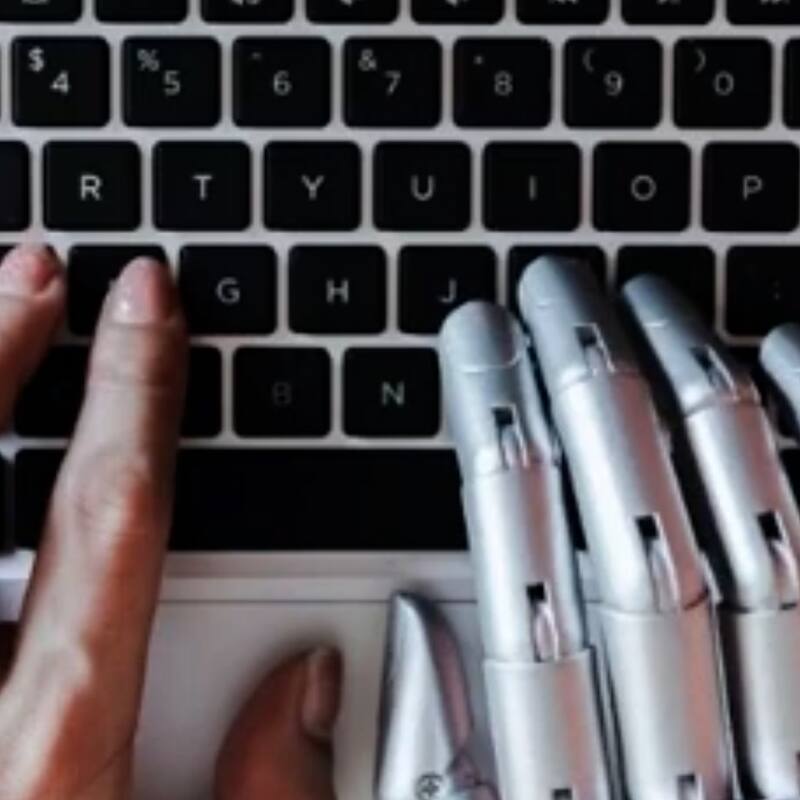

Hoy, circuitos mucho más poderosos y pequeños que Perceptron, pero de arquitectura similar, forman nuestro cotidiano. Todo tipo de dispositivos median y registran nuestras interacciones en las redes sociales. Las posibilidades de estas herramientas son gigantes. Mientras la academia debate si son “inteligentes”, ellas continúan clasificando todo tipo de datos y los utilizan para predecir, por ejemplo, la potencial criminalidad de una persona.

¿Qué son estas “inteligencias artificiales”? Son algoritmos que aprenden a clasificar, “entrenados” inicialmente por datos, que se van ajustando como Rosenblatt ajustaba sus circuitos. Siguiendo con el ejemplo, después de ser alimentados con información de las personas, determinan si éstas “representan/no representan riesgo” para la sociedad. Como son computadores y no poseen emociones humanas, ¿tomarán decisiones más “objetivas” y justas? La clave está en el entrenamiento: si la base de datos es sesgada, el algoritmo lo será. En una larga lista de casos, el sexo, el color de piel y el barrio, fueron motivo para clasificar injustamente a personas, debido a un algoritmo entrenado con datos llenos de nuestros sesgos.

¿Podemos quedar al margen de este cambio tecnológico y sus consecuencias sociales? ¿Debiésemos preocuparnos de educar mucho más sobre estos temas? Cualquier disciplina o sector laboral se beneficiaría de una mayor comprensión del funcionamiento de estos algoritmos y las máquinas asociadas. Son herramientas ya integradas a nuestras vidas con un alcance mayor del que creemos. Por eso, necesitamos entenderlas, para usarlas de acuerdo con nuestros fines y para discutir qué usos queremos evitar. Para debatir esto se necesita, no una, sino una confluencia de disciplinas: artes y humanidades, ciencias sociales y naturales, básicas y aplicadas. De otro modo, solo usaremos lo que nos ofrezca el mercado, decidiremos sobre lo que no entendemos y tendremos simplemente que vivir las consecuencias de las inteligencias creadas por nuestra inteligencia. Ambas entre comillas.

*Director de Diplomado en Neurociencia Social UDP.

Lea también en Qué Pasa:

COMENTARIOS

Para comentar este artículo debes ser suscriptor.

Lo Último

Lo más leído

La mayoría no entiende el debate por el impuesto a las empresas. El resto lee La Tercera.

Plan Digital+$6.990 al mes SUSCRÍBETE