Facebook dice que la IA limpiará la plataforma. Sus propios ingenieros tienen dudas

La IA tiene un éxito mínimo en la eliminación del discurso de odio, las imágenes violentas y otros contenidos problemáticos, según informes internos de la empresa.

Los ejecutivos de Facebook han dicho durante mucho tiempo que la Inteligencia Artificial (IA) abordaría los problemas crónicos de la compañía manteniendo lo que considera discurso de odio y violencia excesiva, así como a los usuarios menores de edad fuera de sus plataformas.

Ese futuro está más lejos de lo que sugieren esos ejecutivos, según documentos internos revisados por The Wall Street Journal. La IA de Facebook no puede identificar consistentemente videos de disparos en primera persona, diatribas racistas e incluso, en un episodio notable que desconcertó a los investigadores internos durante semanas, la diferencia entre peleas de gallos y accidentes automovilísticos.

Sobre el discurso de odio, según muestran los documentos, los empleados de Facebook han estimado que la compañía elimina solo una parte de las publicaciones que violan sus reglas, un porcentaje bajo de un solo dígito, dicen. Cuando los algoritmos de Facebook no están lo suficientemente seguros de que el contenido viola las reglas para eliminarlo, la plataforma muestra ese material a los usuarios con menos frecuencia, pero las cuentas que publicaron el material quedan impunes.

Los empleados estaban analizando el éxito de Facebook en la aplicación de sus propias reglas sobre el contenido que detalla internamente y en documentos públicos como los estándares de su comunidad.

Los documentos revisados por The Wall Street Journal también muestran que Facebook hace dos años redujo el tiempo que los revisores humanos se centraron en las quejas de incitación al odio de los usuarios e hicieron otros ajustes que redujeron el número total de quejas. Eso hizo que la empresa dependiera más de la aplicación de sus reglas por parte de la IA e infló el aparente éxito de la tecnología en sus estadísticas públicas.

Según los documentos, los responsables de mantener la plataforma libre de contenido que Facebook considere ofensivo o peligroso reconocen que la compañía no está ni cerca de poder filtrarlo de manera confiable.

“El problema es que no tenemos y posiblemente nunca tendremos, un modelo que capture incluso la mayoría de los daños a la integridad, particularmente en áreas sensibles”, escribió un ingeniero senior y científico investigador en una nota de mediados de 2019.

Estimó que los sistemas automatizados de la compañía eliminaron las publicaciones que generaron solo el 2% de las vistas de discurso de odio en la plataforma que violaba sus reglas. “Estimaciones recientes sugieren que, a menos que haya un cambio importante en la estrategia, será muy difícil mejorar esto más allá del 10-20% en el corto-mediano plazo”, escribió.

En marzo, otro equipo de empleados de Facebook llegó a una conclusión similar, estimando que esos sistemas estaban eliminando publicaciones que generaban entre el 3% y el 5% de las visitas de incitación al odio en la plataforma y el 0,6% de todo el contenido que violaba las políticas de Facebook contra la violencia y la violencia. incitación.

El portavoz de Facebook, Andy Stone, dijo que estos porcentajes se referían a publicaciones que se eliminaron mediante inteligencia artificial y no incluían otras acciones que la compañía toma para reducir la cantidad de personas que ven el discurso de odio, incluidas las publicaciones de clasificación más baja en las noticias. Facebook dice que según esa medida, la prevalencia de contenido que viola sus políticas se ha ido reduciendo, y eso es lo que la compañía considera su métrica de cumplimiento más importante.

Las estadísticas contrastan marcadamente con la confianza en la inteligencia artificial presentada por los principales ejecutivos de Facebook, incluido el director ejecutivo Mark Zuckerberg, quien anteriormente dijo que esperaba que Facebook usara la inteligencia artificial para detectar “la gran mayoría del contenido problemático” para fines de 2019.

La compañía a menudo dice que casi todo el discurso de odio que elimina fue descubierto por IA antes de que los usuarios lo denunciaran. Llama a esta cifra su tasa de detección proactiva, y había alcanzado casi el 98% a principios de este año.

Los grupos de derechos civiles y académicos han sido escépticos durante mucho tiempo de que la tasa de detección de IA muestre un progreso significativo, diciendo que no parece coincidir con las experiencias de los usuarios o sus propios estudios. “Nunca mostrarán su trabajo”, dijo Rashad Robinson, presidente del grupo de derechos civiles Color of Change, que ayudó a organizar un boicot de anunciantes a Facebook el año pasado debido a lo que llamó la falla de la compañía para controlar el discurso de odio.

“Preguntamos, ¿cuál es el numerador? ¿Cuál es el denominador? ¿Cómo obtuviste ese número? " él dijo. “Y luego es como grillos”.

En una entrevista, el jefe de integridad de Facebook, Guy Rosen, dijo que era más importante observar otros puntos de datos que muestran la cantidad de discurso de odio que se reduce como un porcentaje de lo que la gente ve en la plataforma en general. Facebook dice que cinco de cada 10.000 vistas de contenido contenían discurso de odio, una mejora de aproximadamente 10 de cada 10.000 vistas a mediados de 2020, según su último informe público sobre cómo hace cumplir sus políticas, para el segundo trimestre de este año.

“La prevalencia es la métrica más importante y no representa lo que detectamos, sino lo que nos perdimos y lo que la gente vio, y es la métrica principal de la que somos responsables”, dijo Rosen. “Hemos tenido éxito en moverlo hacia abajo, y es en el que realmente nos enfocamos”.

Stone, el portavoz, dijo que los ejecutivos de Facebook han enfatizado cada vez más esta medida en sus comentarios públicos. Dijo que gran parte de la mejora se debe a que la inteligencia artificial clasifica el contenido sospechoso más bajo para darle menos visibilidad.

Rosen también dijo que los documentos revisados por The Wall Street Journal estaban desactualizados, pero que habían informado el pensamiento más amplio de Facebook sobre la moderación de contenido impulsada por la inteligencia artificial.

El mes pasado, la compañía dijo que sus sistemas de inteligencia artificial estaban mejorando para “eliminar de manera proactiva el contenido que viola nuestros estándares sobre el discurso del odio” y dijo que estaba eliminando 15 veces más de este contenido que en 2017.

Los documentos son parte de extensas comunicaciones internas revisadas por The Wall Street Journal que ofrecen una mirada sin precedentes a las luchas de Facebook para administrar los productos y sistemas en el corazón de su éxito comercial.

La serie de The Wall Street Journal, basada en documentos y entrevistas con empleados actuales y anteriores, describe cómo las reglas de la empresa favorecen a las élites; cómo sus algoritmos fomentan la discordia; que sabe desde hace mucho tiempo que los cárteles de la droga y los traficantes de personas utilizan sus servicios abiertamente; y cómo los activistas antivacunas utilizan Facebook, entre otras cuestiones. Un artículo sobre los efectos de Instagram en la salud mental de las adolescentes impulsó una audiencia en el Senado a fines de septiembre.

Ejemplos de contenido que la IA de Facebook debería haber detectado pero no se pudo ver incluyen videos de primeros planos de una persona disparándole a alguien y videos de accidentes automovilísticos con “desmembramiento y entrañas visibles”, según los documentos. Otras violaciones de las políticas de Facebook que se filtraron a través de IA fueron las amenazas violentas dirigidas a niños transgénero.

Facebook dice que ha gastado alrededor de US$13 mil millones en “seguridad y protección” desde 2016, o casi el 4% de sus ingresos en ese tiempo. Rosen dijo que en 2016, el sistema de moderación de contenido de Facebook se basó en gran medida en las quejas de los usuarios y que desde entonces la compañía ha creado herramientas de inteligencia artificial para encontrar el contenido objetable.

En 2018, Zuckerberg le dijo a un comité del Senado que era optimista de que dentro de cinco a 10 años, Facebook tendría las herramientas de inteligencia artificial para detectar de manera proactiva la mayoría de los discursos de odio. “A largo plazo, la creación de herramientas de inteligencia artificial será la forma escalable de identificar y erradicar la mayor parte de este contenido dañino”, dijo en ese momento.

En julio de 2020, le dijo al Congreso: “En términos de lucha contra el odio, hemos construido sistemas realmente sofisticados”.

Un ejecutivo de Facebook testificó en la audiencia del Senado a fines de septiembre que la compañía está usando inteligencia artificial para mantener a los niños menores de 13 años fuera de Instagram.

‘Bastante ingenuo’

Los sistemas de inteligencia artificial de Facebook revisan miles de millones de publicaciones en busca de elementos que puedan coincidir con las definiciones de contenido de la empresa que violan sus reglas. Los algoritmos de selección, llamados clasificadores, son la base del sistema de moderación de contenido de la empresa.

La construcción de estos clasificadores es laboriosa y compleja, y requiere un ejército de humanos para marcar una gran cantidad de publicaciones según un conjunto de reglas. Luego, los ingenieros toman estos ejemplos y capacitan sus sistemas para determinar la probabilidad de que otros puestos violen las reglas.

Los algoritmos de Facebook pueden eliminar automáticamente el discurso de odio cuando alcanzan un cierto nivel de confianza en que la publicación viola las políticas, o pueden presionar más abajo en los feeds de publicaciones más cuestionables para limitar su propagación.

En algunas áreas, como con el spam, los clasificadores de Facebook funcionan relativamente bien. Pero a menudo se quedan cortos en áreas sensibles y controvertidas, especialmente cuando las reglas de Facebook son complejas y el contexto cultural importa, según los documentos y las personas familiarizadas con el tema.

“Los clasificadores son como estudiantes de escuela primaria y necesitan maestros (revisores humanos) para convertirse en doctores”, escribió un ingeniero de Facebook en una discusión sobre los costos del discurso de odio en la plataforma interna de empleados de Facebook en agosto de 2019. Basado en una medida de éxito, el ingeniero escribió, “nuestros clasificadores todavía son bastante ingenuos”.

En un ejemplo, IA etiquetó un video de un lavado de autos como un video de disparos en primera persona, según los documentos. En otro, confundió un video de un tiroteo con un accidente automovilístico.

Algunos empleados dicen que Facebook está haciendo un mal uso de los clasificadores, que dicen que son más efectivos como herramientas para marcar áreas problemáticas amplias que como la herramienta principal para eliminar problemas de contenido específicos.

En 2019, los documentos revisados por The Wall Street Journal muestran que Facebook introdujo “controles de costos de incitación al odio” para ahorrar dinero en sus operaciones de revisión de contenido humano. La revisión del discurso de odio por parte del personal humano costaba US$ 2 millones a la semana, o US$104 millones al año, según un documento interno que cubre la planificación para la primera mitad de ese año.

“Dentro de nuestro presupuesto total, el discurso del odio es claramente el problema más costoso”, escribió un gerente sobre el esfuerzo en un documento separado, declarando que el costo de vigilar los insultos y la denigración de los grupos minoritarios, que las reglas de Facebook prohíben, se suma a dinero real.”

Stone, el portavoz, dijo que los fondos se cambiaron para contratar a más personas para entrenar los algoritmos de Facebook y que el presupuesto general se mantuvo estable.

Aproximadamente el 75% de los costos provino de emplear personas para revisar las quejas de los usuarios, la gran mayoría de las cuales se consideró, después de la revisión, que no eran un discurso de odio, según muestran los documentos. En 2019, más allá de simplemente reducir la cantidad de horas de los contratistas dedicadas a revisar el discurso de odio, la compañía comenzó a emplear un algoritmo que los llevó a ignorar un mayor porcentaje de informes de usuarios que el sistema consideraba poco probable que fueran violaciones.

También introdujo “fricciones” en el proceso de presentación de informes de contenido, agregando obstáculos para que los usuarios agraviados saltaran, lo que redujo drásticamente la cantidad de quejas sobre el contenido, según los documentos.

“Es posible que hayamos movido la aguja demasiado lejos”, reconoció el autor de uno de los documentos sobre los esfuerzos de la compañía para hacer menos probable que los usuarios completen sus informes sobre el discurso de odio a la compañía.

Los movimientos ayudaron a impulsar la tasa de detección proactiva de la empresa, es decir, una mayor proporción del contenido que se eliminó fue marcado por IA, la cifra que ahora es casi el 98%. En diciembre de 2017, IA detectó el 24% de los discursos de odio eliminados y el resto de los informes de los usuarios, según el informe público trimestral de Facebook sobre cómo aplica sus políticas.

Stone dijo que las medidas para ignorar los informes de los usuarios que se considera poco probable que sean violaciones y la adición de fricción no tenían la intención de cambiar la tasa de detección proactiva, sino que tenían la intención de hacer que el sistema fuera más eficiente. Añadió que desde entonces se ha revertido parte de esa fricción adicional.

El desempeño de los sistemas automatizados de Facebook ilustra lo difícil que es para Facebook y otras empresas de tecnología crear sistemas que detecten de manera confiable y completa el contenido que infringe sus reglas.

“Este es uno de los problemas más difíciles del aprendizaje automático”, dijo J. Nathan Matias, profesor asistente de la Universidad de Cornell. “También es un área que muchas empresas y responsables políticos han decidido que sería la solución, sin comprender el problema”.

Experiencia de usuario

La discrepancia entre las afirmaciones públicas de Facebook sobre la efectividad de su IA y la realidad de la experiencia del usuario ha desconcertado a los investigadores y otros usuarios habituales de la plataforma durante mucho tiempo.

En 2016, la estrella del pop Selena Gomez voló a la sede de Menlo Park de Facebook para posar para fotos con Zuckerberg y la directora de operaciones de Facebook, Sheryl Sandberg, para celebrar su estatus como la cuenta más seguida en Instagram. No mucho después, se sorprendió al leer un comentario de un usuario en una de sus publicaciones de Instagram: “Ve a suicidarte”, según el portavoz de la estrella.

Se preocupó cada vez más por la propagación del discurso de odio en estas plataformas, y en septiembre de 2020 envió un mensaje de Instagram que luego publicó en su cuenta a Zuckerberg y Sandberg, diciendo que la empresa tenía un “problema grave” con el odio, desinformación, racismo e intolerancia.

Luego, la Sra. Gómez envió un correo electrónico para preguntar por qué Facebook permitió que los grupos de odio prosperen en el sitio, según los correos electrónicos revisados por The Wall Street Journal y reportados previamente por Associated Press. Sandberg respondió que la inteligencia artificial de Facebook había detectado el 91% de los 1,5 millones de publicaciones que eliminó por violar sus reglas contra el uso de símbolos o frases de grupos de odio.

La Sra. Gómez respondió que Sandberg no había abordado sus preguntas más amplias, enviando capturas de pantalla de grupos de Facebook que promovían ideologías violentas.

“Usted se niega a mencionar, y mucho menos abordar, el problema que Facebook tiene con los supremacistas blancos y los fanáticos”, escribió la Sra. Gómez en un correo electrónico del 10 de octubre de 2020 a la Sra. Sandberg y otros ejecutivos, agregando que había un montón de Facebook. grupos “llenos de odio y mentiras que pueden hacer que las personas resulten heridas o, peor aún, que las maten”.

La Sra. Gómez declinó las solicitudes de comentarios adicionales.

Stone dijo que Sandberg ha destacado públicamente las cifras de prevalencia del discurso de odio en Facebook este año.

Fadi Quran, investigador del grupo de derechos humanos Avaaz, que aboga por la acción ciudadana en áreas como el cambio climático y la pobreza, dijo que ha preguntado repetidamente a los empleados de Facebook si entendían cuánto discurso de odio había en su plataforma. “Dijeron textualmente que eso era casi imposible, y solo pueden informar con certeza sobre lo que detectan”, dijo.

“Al ocultar el problema y dar la impresión opuesta, que el problema está bajo control, en realidad son cómplices de permitir que esas violaciones comunitarias sigan adelante con una responsabilidad mínima”, dijo.

Stone dijo que Facebook le proporcionó al Sr. Quran cifras de prevalencia pública y otras métricas.

En sus informes públicos trimestrales sobre cómo aplica sus políticas, Facebook mide la prevalencia de ciertos tipos de contenido, como el discurso de odio, por la cantidad de visitas que atrae el contenido. La compañía dice que esta es una forma más precisa de medir el verdadero impacto de un contenido que viola sus políticas. En otras palabras, el discurso de odio visto un millón de veces es más un problema que el discurso de odio visto solo una vez.

La compañía no informa públicamente qué porcentaje de opiniones de incitación al odio elimina. Internamente, la compañía calcula esta cifra aplicando sus clasificadores de incitación al odio a una muestra de publicaciones y luego haciendo que los humanos revisen las mismas publicaciones para ver cuánto se perdieron los clasificadores, según una persona con conocimiento directo de las estimaciones. Luego, el número se usa como una estimación de la cantidad de vistas de incitación al odio eliminadas en toda la plataforma.

Rosen, el jefe de integridad, dijo en la entrevista que los informes públicos trimestrales de la compañía son evidencia de que se está tomando estos problemas en serio.

Peleas de gallos, accidentes automovilísticos

A mediados de 2018, un ingeniero notó una tendencia preocupante: “muchos choques de autos y peleas de gallos en los datos de prevalencia”, escribió en un informe interno de 2019. Los usuarios de Facebook encontraban en sus feeds videos de autos chocando y gallos peleando, lo que normalmente violaría las reglas de Facebook. Los científicos de datos no estaban seguros de por qué.

El ingeniero y un equipo de colegas entrenaron un sistema de inteligencia artificial para reconocer videos de peleas de gallos y choques automovilísticos y eliminarlos. “Sin embargo”, escribieron los ingenieros en un memorando, “el problema no se resolvió realmente”.

Facebook también estableció reglas para las peleas de gallos que la IA tuvo problemas para seguir. Las peleas de gallos leves se consideraron aceptables, pero se prohibieron aquellas en las que las aves resultaron gravemente heridas. Pero el modelo de computadora no pudo distinguir los gallos de pelea de los gallos que no lo hacen.

Para entrenar los sistemas de la empresa, los ingenieros emplearon sofisticados programas de aprendizaje automático con nombres como “Visión profunda” y les proporcionaron horas y horas de videos de peleas de gallos. Enseñar a la IA a señalar un pájaro gravemente herido e ignorar uno menos herido resultó difícil.

“Esto es difícil de captar”, escribieron los ingenieros.

En dos casos en los que los ingenieros consiguieron que la inteligencia artificial marcara una pelea de gallos, encontraron otro problema: “Estos son claramente videos de peleas de gallos”, pero fueron etiquetados como accidentes automovilísticos, escribieron los investigadores.

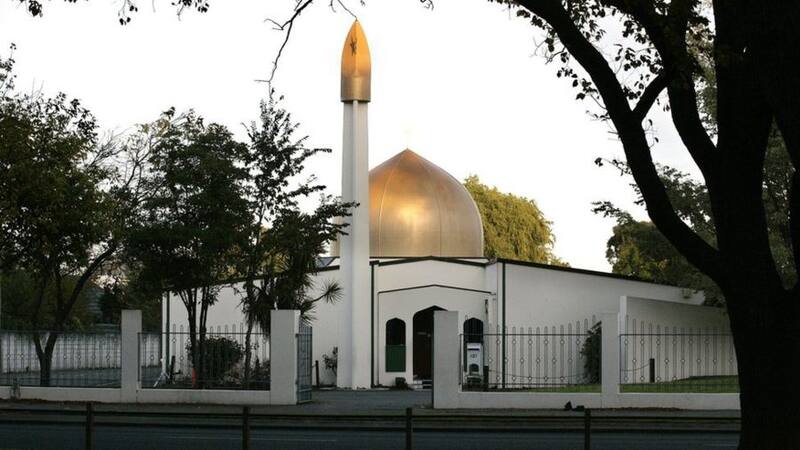

El mismo equipo encontró obstáculos alrededor de los disparos registrados por el perpetrador, conocidos como videos de “disparos en primera persona”, dice el memorando interno. Tres meses antes de que se escribiera el memorando, un hombre en Christchurch, Nueva Zelanda, usó Facebook para transmitir en vivo el tiroteo fatal de 51 personas en dos mezquitas.

En algunos casos, la IA no reconoció los disparos. En otros, etiquetó incorrectamente videos inocuos, como juegos de paintball o el lavado de autos, escribieron los investigadores.

Faltan idiomas extranjeros

La IA también debe estar capacitada en idiomas extranjeros.

Según un memorando de diciembre de 2020, los empleados de Facebook debatieron la creación de un clasificador de discursos de odio para varios dialectos árabes. Pero la falta de datos de entrenamiento, como muestras de varios dialectos, fue un problema, especialmente porque tenían problemas con el árabe estándar. “Tal como están las cosas, apenas tienen contenido suficiente para capacitar y mantener el clasificador árabe en la actualidad, y mucho menos problema”, escribió un empleado en un documento.

En enero, un empleado de Facebook informó que la incitación al odio era una de las principales “categorías de abuso” en Afganistán, pero la empresa tomó medidas contra solo el 0,23% de las publicaciones de incitación al odio estimadas en el país.

El empleado dijo que la lista “seriamente escasa” de insultos de la empresa en los idiomas hablados en Afganistán significaba que podrían faltar muchas publicaciones infractoras.

En marzo, los empleados que se preparaban para las elecciones regionales en India dijeron que el discurso de odio era un riesgo importante en Assam, donde hay una creciente violencia contra los musulmanes y otros grupos étnicos. “Assam es motivo de especial preocupación porque no tenemos un clasificador de discurso de odio de Assam”, según un documento de planificación.

Si bien Facebook elimina una pequeña fracción del contenido que viola sus reglas, los ejecutivos son particularmente sensibles a lo que llama “aplicación excesiva” o eliminar demasiadas publicaciones que en realidad no violan las reglas de incitación al odio, según personas familiarizadas con el asunto. El énfasis en prevenir esos errores ha empujado a los ingenieros de la empresa a entrenar modelos que, en efecto, permiten más discursos de odio en la plataforma para evitar falsos positivos, según la gente.

Su propia investigación interna muestra que los usuarios de Facebook en todo el mundo están más preocupados por la falta de cumplimiento. En marzo de 2020, Facebook descubrió que los usuarios, en promedio, calificaron ver contenido en violación como el discurso de odio como una experiencia más negativa que que se elimine su contenido por error, según los documentos.

A nivel mundial, los usuarios clasificaron las eliminaciones de contenido inexacto en último lugar entre una serie de problemas, mientras que el discurso de odio y la violencia encabezaron la lista. Los usuarios estadounidenses estaban más preocupados por las eliminaciones inexactas, pero aún calificaron el problema detrás del discurso de odio y la violencia, muestra la encuesta.

En una nota de finales de 2020, un científico de datos que partió señaló que Facebook tiene una política de permitir que los grupos sancionen el discurso de odio cinco veces antes de que sean eliminados de la plataforma. Debido a que los sistemas de Facebook pierden tanto discurso de odio, es probable que los grupos se salgan con la suya mucho más, escribió el científico de datos.

“Cuando consideras que pasamos por alto el 95% de las violaciones del discurso de odio, te das cuenta de que en realidad podrían ser necesarias 100 violaciones para que ese grupo acumule sus cinco advertencias”, dijo en la nota, que fue previamente reportada por BuzzFeed.

El científico de datos saliente señaló que, a pesar de la intensa inversión de Facebook, la tasa de éxito de la compañía en la eliminación de contenido prohibido siguió siendo desalentadora. “Cada semestre [año] hacemos un progreso incremental en la cantidad de contenido que podemos detectar de manera proactiva”, escribió. “Pero un aumento incremental en un número muy pequeño sigue siendo un número muy pequeño”.

“Podríamos ser los mejores del mundo en eso”, escribió, “pero lo mejor del mundo no es lo suficientemente bueno como para encontrar una fracción”.

Lea los otros artículo de la investigación de The Wall Street Journal en Qué Pasa:

COMENTARIOS

Para comentar este artículo debes ser suscriptor.

Lo Último

Lo más leído

Casi nadie tiene claro qué es un modelo generativo. El resto lee La Tercera.

Plan Digital + LT Beneficios$6.990 al mes SUSCRÍBETE